Texto Extraido e modificado de: itirupati.com

Josemar Sena Tweet

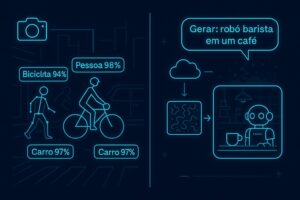

Em poucas palavras, o termo Inteligência Artificial (IA) refere-se à simulação da inteligência humana em máquinas projetadas para pensar e agir como humanos. Este campo abrange uma ampla gama de tecnologias e aplicações, incluindo aprendizado de máquina, processamento de linguagem natural (PNL), robótica e visão computacional. Sistemas de IA são desenvolvidos para executar tarefas que normalmente exigem inteligência humana, como reconhecer a fala, compreender a linguagem, tomar decisões e resolver problemas.

O termo “Inteligência Artificial” foi cunhado em 1956 por John McCarthy, Marvin Minsky, Nathaniel Rochester e Claude Shannon durante a Conferência de Dartmouth. Esta conferência é considerada o berço da IA como disciplina acadêmica. Os primeiros anos da IA foram caracterizados por otimismo e financiamento significativo, levando ao desenvolvimento de programas capazes de jogar xadrez e resolver problemas de álgebra.

Aprendizado de máquina, ou Machine Learning (ML) é um subconjunto da IA focado no desenvolvimento de algoritmos que permitem que computadores aprendam com dados e melhorem seu desempenho ao longo do tempo sem serem explicitamente programados. Modelos de ML são treinados em grandes conjuntos de dados e podem identificar padrões, fazer previsões e melhorar com a experiência.

Os dados são a alma dos sistemas de IA. Modelos de aprendizado de máquina exigem grandes quantidades de dados para aprender e fazer previsões precisas. A qualidade e a quantidade de dados impactam significativamente o desempenho dos modelos de IA. A análise de dados envolve a limpeza, o processamento e a transformação de dados brutos em um formato adequado para modelos de treinamento.

A IA tem o potencial de transformar diversos setores, incluindo saúde, educação, finanças e transporte. Ela pode aumentar a eficiência, aprimorar a tomada de decisões e criar novas oportunidades. No entanto, também levanta preocupações sobre a substituição de empregos e o uso ético da tecnologia.

A Inteligência Artificial é um campo em rápida evolução, com profundas implicações para a sociedade. Da IA simbólica inicial às modernas técnicas de aprendizado de máquina e aprendizado profundo, a IA fez avanços notáveis na resolução de problemas complexos e no aprimoramento das capacidades humanas. Histórias de sucesso como AlphaGo, IBM Watson, veículos autônomos e modelos GPT ilustram o potencial transformador da IA. À medida que a IA avança, abordar questões éticas, garantir a equidade e promover a transparência será crucial para aproveitar seus benefícios de forma responsável. O futuro da IA oferece possibilidades empolgantes, e seu desenvolvimento contínuo promete impulsionar a inovação em diversos domínios.

A Inteligência Artificial é um campo em rápida evolução, com profundas implicações para a sociedade. Da IA simbólica inicial às modernas técnicas de aprendizado de máquina e aprendizado profundo, a IA fez avanços notáveis na resolução de problemas complexos e no aprimoramento das capacidades humanas. Histórias de sucesso como AlphaGo, IBM Watson, veículos autônomos e modelos GPT ilustram o potencial transformador da IA. À medida que a IA avança, abordar questões éticas, garantir a equidade e promover a transparência será crucial para aproveitar seus benefícios de forma responsável. O futuro da IA oferece possibilidades empolgantes, e seu desenvolvimento contínuo promete impulsionar a inovação em diversos domínios.